ByteDance und Kuaishou treffen sich wieder auf schmalem Weg im Bereich der KI-Videos.

Text | Zhou Xinyu

Redaktion | Su Jianxun

Mitte April 2025 stießen die beiden alten Rivalen Kuaishou und ByteDance im Bereich der KI-gestützten Videogenerierung erneut aufeinander.

Zunächst ging am 14. April das Video-Generierungs-Basis-Modell Seaweed von ByteDance stillschweigend auf seine offizielle Website live und veröffentlichte auch einen Technologiebericht.

△Video generiert von Seaweed. Quelle: Offizielle Seaweed-Website

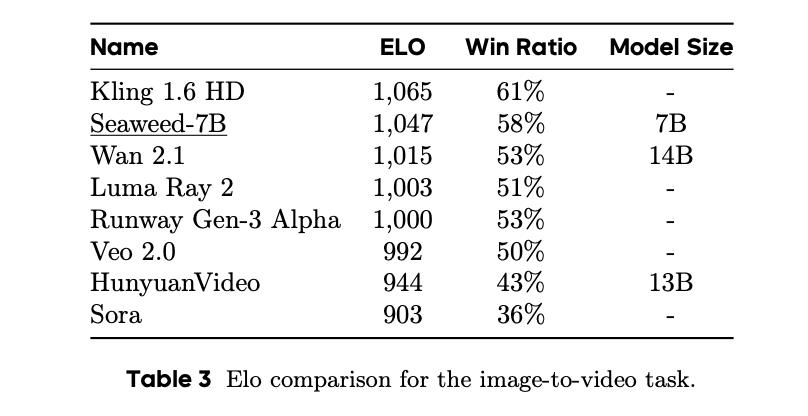

„Mit wenig Kraft viel bewirken“ ist das Ziel, das ByteDance dieses Mal im Videobereich erreichen möchte. Das erstmalig veröffentlichte Modell Seaweed-7B erreicht mit nur 7 Milliarden Parametern bessere Ergebnisse als vergleichbare Modelle mit 14 Milliarden Parametern und hat auch eine bemerkenswert hohe Trainings-effizienz: Während die Trainingszeit vergleichbarer Modelle im Durchschnitt Millionen von GPU-Stunden beträgt, benötigte Seaweed-7B nur 665.000 H100-GPU-Stunden.

Trainings-effizienz von Seaweed-7B.

Im Gegensatz zu ByteDances Zurückhaltung will Kuaishou im Bereich der Videogenerierung eine viel größere Kulisse schaffen.

Am 15. April stellte Gai Kun, stellvertretender Vorsitzender von Kuaishou und Leiter der Hauptplattform und der Community-Wissenschaftsabteilung, auf einer Pressekonferenz vor mehreren hundert Teilnehmern die Errungenschaften von Kuaishou im Bereich der Videogenerierung in höchsten Tönen dar:

„Keling hat den Startschuss für den gesamten Videogenerierungs-Sektor gegeben.“ „Nach uns begannen alle Hersteller, Videogenerierungs-Modelle zu veröffentlichen.“

Tatsächlich hat das Videogenerierungs-Modell „Keling“ von Kuaishou, das am 6. Juni 2024 veröffentlicht wurde, dank einer großzügigen kostenlosen Testphase unter den vielen „Sora-Zukunftsprojekten“ den Rekord erreicht, innerhalb von drei Monaten über 2,6 Millionen Benutzer zu bedienen.

Dies war auch das erste Duell zwischen ByteDance und Kuaishou im Videobereich. Die Veröffentlichung von „Keling“ brachte ByteDance vorübergehend in die Rolle des Verfolgenden. Erst am 8. November 2024 kehrte ByteDance in die Spitzengruppe des Videobereichs zurück: Seaweed und PixelDance starteten die Videogenerierungsplattform Jimeng AI.

Viele Branchenmitglieder gaben an, dass ByteDance im Jahr 2024 im Bereich der Videoleistung heftig nachholte und schließlich mit Kuaishou annähernd auf Augenhöhe stand.

Bei diesem gemeinsamen Auftritt ein Jahr später scheint Kuaishou auch nicht bereit zu sein, die Spitze in Sachen Technologie abzugeben.

„Global weit vorne.“ „Dauerhaft führend.“ „Bitten Sie mich, diese beiden Sätze noch einmal zu wiederholen.“

Beim Vorstellen der neuen Ergebnisse heizte Gai Kun das Publikum erneut auf. Er kündigte die neuesten Forschungsergebnisse von Kuaishou im Bereich der Multimodalität an: das Bildgenerierungs-Basis-Modell „Ketuku 2.0“, das Videogenerierungs-Basis-Modell „Keling 2.0“ sowie die Multimodal-Editor-Funktion MVL.

△Video generiert von „Keling 2.0“. Quelle: Kuaishou

Bei der Videogenerierungsfähigkeit übertrifft „Keling 2.0“ sowohl in der Text-zu-Video- als auch in der Bild-zu-Video-Generierung das Videomodel Veo2 von Google. Im Duell mit dem alten Rivalen Sora erreichte das Text-zu-Video-Modell von „Keling 2.0“ sogar ein Siegesverhältnis von 367%.

Fähigkeiten von „Keling 2.0“.

Der Aufschwung von DeepSeek hat die Branche darauf aufmerksam gemacht, dass das Modell die Obergrenze von KI-Produkten festlegt. Im Jahr 2025 richten viele Hersteller ihren Fokus wieder auf das Modell.

ByteDance und Kuaishou haben derzeit unterschiedliche Ambitionen für ihre KI-gestützten Videogenerierungs-Produkte. Laut Informationen ist ByteDances Hoffnung auf „Jimeng“ ein TikTok für die KI-Zeit, ein zukünftiges, eher ToC-Produkt. Kuaishou setzt dagegen hauptsächlich auf die B2B-Geschäftsidee.

Trotzdem besteht im Jahr 2025 ein Konsens zwischen den beiden Herstellern: Sie wollen ihre Videobasis-Modelle verfeinern und sich in die Spitzengruppe katapultieren.

Laut einem Bericht von „LatePost“ ist eines der OKRs von Zhang Nan, Leiterin der Bild- und Videocreation-Plattform „Jimeng“ von ByteDance, für das Jahr 2025 die Verbesserung der Modellleistung. Das Ziel des „Keling“-Teams im Jahr 2025 lässt sich in den vier Worten von Gai Kun zusammenfassen: „Dauerhaft führend.“

Für ByteDance und Kuaishou wird das Feuer im Bereich der Videogenerierung zumindest auf technischer Ebene nur heftiger werden.

Konkurrenz um Leistung und Umsetzung

Dieses „Duell“ im April ist für ByteDance und Kuaishou nicht nur ein Vergleich der Leistung ihrer Videomodelle.

Die Schwierigkeiten bei der Umsetzung von Videomodellen sind ein altbekanntes Problem. Abgesehen von den nicht zufriedenstellenden Ergebnissen der Modelle ist der hohe Preis ein generelles Problem von Videomodellen. Ein typisches Beispiel ist, dass OpenAI für sein Sora-Modell einen monatlichen Abonnementpreis von 200 US-Dollar verlangt, um die hohen Inferenzkosten zu decken.

Im Vergleich zum „Technikshow“-Jahr 2024 steht im Jahr 2025 der Videomodell-Wettbewerb mehr auf Nützlichkeit und Kosteneffizienz.

Beispielsweise ist das Seaweed-7B von ByteDance zwar in der Leistung etwas hinter Kuaishous Vorgängermodell „Keling 1.6“ zurück, aber es hat den Vorteil, dass es mit sehr geringen Bereitstellungskosten auskommt: Ein einzelner GPU mit nur 40 GB Grafikspeicher reicht aus, um Videos in hoher Auflösung (1280x720) zu generieren.

Das bedeutet, dass auch kleine Teams und private Kreatoren sich die KI-gestützte Videocreation leisten können.

Was die Nützlichkeit betrifft, besteht zwischen ByteDance und Kuaishou ein Konsens: Ein einzelnes Videogenerierungsmodell kann derzeit die kreativen Bedürfnisse der Benutzer nicht vollständig befriedigen.

Auf der Pressekonferenz zur Veröffentlichung von „Keling 2.0“ stellte Kuaishou auch das Bildgenerierungsmodell „Ketuku 2.0“ vor. Dieses Modell, das verbesserte Befolgungsfähigkeit von Anweisungen und ästhetische Fähigkeiten aufweist, hat auf dem Wettbewerbstage die drei führenden Modelle Midjourney v7, Rave und FLUX1.1 pro übertroffen.

△Bild generiert von „Ketuku 2.0“, Prompt: Ein Festsaal mit weißen Tischen, um die herum Leute ein schönes Essen genießen. Quelle: Kuaishou

Nach Ansicht von Zhang Di, stellvertretender Technologiechef von Kuaishou und Leiter von Keling AI, ist die Bildverarbeitungsfähigkeit ein unverzichtbarer Schritt bei der Umsetzung von Videomodellen.

Er führte eine Statistik an: In den von „Keling“ generierten Videos machen die Bild-zu-Video-Generierungen 85% aus. Dieser hohe Anteil zeigt, dass bei der praktischen Videocreation mehr Benutzer lieber Bilder verwenden, um den Stil zu bestimmen und Schlüsselbilder hinzuzufügen, um stabilere Videogenerierungsergebnisse zu erzielen.

Die bei der Veröffentlichung von „Keling“ vorgestellte „Multimodal-Editor-Funktion MVL“ soll laut Angabe der Mitarbeiter die Echtzeit-Videoeditor-Bedürfnisse der Kreatoren befriedigen.

Multimodal-Editor-Funktion MVL.

Die Multimodal-Editor-Funktion MVL unterstützt nicht nur Text-Prompts, sondern auch Aktionsbeschreibungsdateien in Bild- und Videomodalität. Beispielsweise kann ein Benutzer durch Hochladen eines neuen Videos die Personen aus dem neuen Video in das bestehende Video einfügen.

Während Kuaishou auf die Bildverarbeitung setzt, nutzt ByteDance seine Stärken in der Textverarbeitung. Seaweed-7B kombiniert ByteDances „Long Context Tuning Technology“ und die Technologie zur Generierung von langen Erzählvideos „VideoAuteur“, um sicherzustellen, dass die generierten Videos auf der Grundlage der globalen Textdeskription und der Szenenbeschreibung des Benutzers konsistent bleiben.

„Die Hoffnung des Dorfes“ und „Keiner darf zurückbleiben“

ByteDance und Kuaishou haben zwar die gleiche Ambition, im Videobereich an die Spitze zu kommen, aber die daraus resultierenden Geschäftssituationen sind unterschiedlich.

Abgesehen von der bekanntermaßen erfolgreichen „Elite-Strategie“ war die Entstehung und das Durchbrechen von „Keling“ im Geschäftsverlauf von Kuaishou eher zufällig.

Laut Informationen von „Intelligent Emergence“ wurde bis Anfang 2024 ein Schlüsselverfahren für die Text-zu-Video-Generierung von dem Keling-Team erst dann besiegt. Im März 2024 sah Gai Kun zum ersten Mal eine Demo von „Keling“.

Die kommerzielle Erwartungshaltung der Firma an die KI war ursprünglich auch nicht sehr hoch. Laut Informationen von „Intelligent Emergence“ war „KI-Kommerzialisierung“ in den OKRs von Wang Jianwei (Thomas), Leiter der kommerziellen Geschäftseinheit von Kuaishou, im vierten Quartal 2024 nicht zu den „O (Objectives, Ziele)“, sondern nur zu den „KR (Key Results, Schlüsselergebnisse)“ unter dem Punkt „Wachstum“.

Kuaishou hat seit langem keine neuen Geschichten mehr. Als Internetunternehmen, das ebenfalls auf dem Kurzzeitvideo-Geschäft aufgebaut ist, hat Kuaishou im Vergleich zu ByteDance, das ständig neue Märkte erobert, ein weniger breites Geschäftsfeld. Bis 2023 lag der Kern der Einnahmen von Kuaishou immer noch in der Onlinewerbung, der Livestreaming-Show und dem E-Commerce auf der Kurzzeitvideo-Plattform.

Aber die Entstehung von „Keling“ hat Kuaishou eine neue Wachstumsmöglichkeit außerhalb des Kurzzeitvideo-Bereichs gezeigt.

Nach den Finanzberichten von Kuaishou hat Keling AI von der Öffnung des API-Service im September 2024 bis Februar 2025 bereits über 100 Millionen Yuan an kumulativen Einnahmen erzielt. Auf Benutzerebene gab Gai Kun auf dieser Pressekonferenz bekannt, dass „Keling“ derzeit 22,23 Millionen Benutzer hat, die monatlich aktiven Benutzer um das 25-fache gestiegen sind und die Anzahl der Unternehmens- und Entwicklerkunden weltweit bereits über 150.000 erreicht hat.

„Keling“ schafft nicht nur eigene Einnahmen, sondern treibt auch andere Geschäftsbereiche von Kuaishou an. Ein Mitarbeiter der kommerziellen Werbedienstplattform „Magnet Engine“ von Kuaishou sagte gegenüber „Intelligent Emergence“, dass „Keling“ einen deutlichen Anstieg des Werbebusinesses von Kuaishou gebracht hat:

„Große Kunden geben monatlich Hunderttausende Yuan für Werbeplatzierungen aus. Die Werbematerialien können mit KI generiert werden. Ein Videoredakteur kann höchstens 10 Werbematerialien pro Tag schneiden, aber Keling kann Tausende generieren. Wir können innerhalb eines Tages Tausende von Werbematerialien mit Algorithmen in den Empfehlungsstrom der Benutzer verteilen.“

Die Veröffentlichung von „Keling 2.0“ ist für Kuaishou die Fortsetzung der „Hoffnung des Dorfes“.

Im Vergleich zu Kuaishou, das mit einem einzelnen Schlag punkten will, hat ByteDance im Bereich der Videogenerierung eine größere Erfolgsdruck.

In den letzten zwei Jahren hat ByteDance in die KI-Branche mit Personal, Rechenleistung und Geld massiv investiert. Aber im Bereich der Textmodelle gibt es DeepSeek, im Bereich der Videomodelle gibt es Keling, und im Bereich der Sprachmodelle kämpft es sich hart mit MiniMaxs Conch AI durch – ByteDance hat alles angegriffen, aber nichts wirklich festgehalten.

Nach gründlicher Selbstreflexion hat ByteDance seit Anfang 2025 eine interne Reform initiiert. Im März 2025 sagte Wu Yonghui, der neue Leiter der KI-Abteilung „Seed“ und ehemaliger Google Fellow, auf einer Mitarbeiterversammlung, dass die Organisationskultur weiter gestärkt werden muss, um ein offenes, tolerantes und selbstbewusstes Forschungsumfeld zu schaffen, und dass das Maß an Technologieoffenheit erhöht werden muss.

Die Veröffentlichung von Seaweed-7B ist ein Meilen