Das von Zhipu veröffentlichte "Arbeits-Agent" erfordert keinen Einladungscode.

Text | Zhou Xinyu → Text | Zhou Xinyu (Da der Name nicht übersetzt werden muss, behalten wir die englische Form bei)

Redaktion | Su Jianxun → Redaktion | Su Jianxun (Da der Name nicht übersetzt werden muss, behalten wir die englische Form bei)

Das Ergebnis der Zeit nach DeepSeek R1 abzuliefern, ist für die heutigen sechs jungen Talente besonders wichtig.

DeepSeek R1 und Manus haben bereits in den Bereichen Inferenzmodell und AI-Agent eine Welle geschlagen. Für die Nachfolger ist es der konservativste Weg, ihnen zu folgen. Beispielsweise hat Baidu das Inferenzmodell Wenxin X1 veröffentlicht, und Tencent hat das Hunyuan Deep Thinking Modell T1 gestartet.

Bei der Open Day am 31. März hat Zhipu, das im chinesischen Kapitalmarkt reichlich Geld bekommen hat, als Ergebnis für das neue Jahr eine "Plus-Version" von R1 und Manus präsentiert - ein Agent-Produkt mit Fähigkeiten tiefgründigen Nachdenkens, "AutoGLM Contemplation (im Folgenden einfach 'Contemplation')", das bereits kostenlos verfügbar ist.

AutoGLM Contemplation.

Das erste AutoGLM von Zhipu hat im November 2024 das erste von einer KI versendete rotes Paket realisiert: Eine KI hat das erste rote Paket in der menschlichen Geschichte versendet. "Contemplation" hat eine stärkere "Schüler-Atmosphäre". Wie ein menschlicher Praktikant kann es auf der Grundlage offener natürlicher Sprachfragen Informationen verstehen, analysieren und Quellen suchen.

Und noch einen Schritt weiter als die "Internetrecherche", "Contemplation" kann Quellen wie CNKI, Xiaohongshu, Offizielle Accounts, JD.com und Juchao Information, die keine öffentlichen APIs anbieten, einsehen und hat gleichzeitig multimodale Verständnisfähigkeiten, um Bilder- und Textinformationen auf Webseiten zu verstehen.

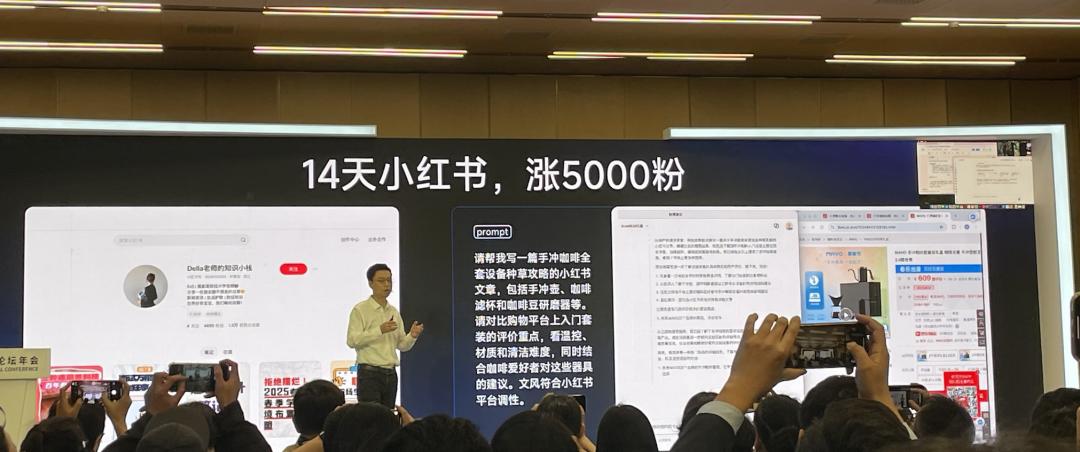

Ein von Zhang Peng gezeigtes Beispiel ist: Mit "Contemplation" einen Xiaohongshu-Account zu betreiben, binnen zwei Wochen 5.000 Follower zu gewinnen und sogar Werbeaufträge zu erhalten.

Die Schlüsselpunkte für das Aufbauen eines Xiaohongshu-Accounts sind erstens eine hohe Aktualisierungsfrequenz und zweitens attraktive Themen. Wenn man nur ein beliebtes Thema eingibt, wie z. B. "Empfehlungsguide für die gesamte Ausrüstung zum Handbrühen von Kaffee", kann "Contemplation" automatisch aus Plattformen wie Xiaohongshu und Zhihu anhand von Hunderten von Quellen eine Zusammenfassung erstellen.

Der von Zhipu mit "Contemplation" betriebene Xiaohongshu-Account.

Nachdem die DeepSeek App den Mythos von 30 Millionen täglichen aktiven Nutzern geschaffen hat, hat sich die Wahrnehmung der Produktparadigmen bei den KI-Herstellern allmählich verändert: Die endgültige Form einer Applikation ist das Modell; die sogenannten Applikationen sind auch zu einer Schauplattform für die Modellfähigkeiten geworden.

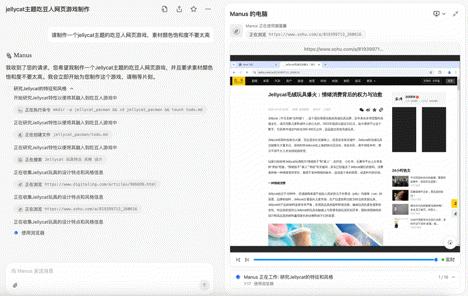

Man kann deutlich spüren, dass das Design der Interaktionsoberfläche von "Contemplation" im Vergleich zu Manus die Denkfähigkeit des Modells stärker hervorhebt.

Während des Denkprozesses zeigt "Contemplation" "Denken", beginnend mit dem Verständnis der Frage, der Zerlegung der Frage, der Informationssuche und schließlich der Aufstellung eines Lösungsrahmens. Manus hingegen legt den Schwerpunkt auf die "Aktion", und die sichtbare Anzeige zeigt den Prozess, wie die KI Tools aufruft.

Vergleich der Oberflächen von "Contemplation" und Manus. Oben "Contemplation", unten Manus.

Vergleich der Oberflächen von "Contemplation" und Manus. Oben "Contemplation", unten Manus.

Im Vergleich zu Manus, das den Ehrgeiz hat, "der weltweit erste universelle Intelligenz-Agent" zu werden, liegt die Bedeutung von "Contemplation" für Zhipu derzeit weniger in der Anwendbarkeit und Umsetzung, sondern eher darin, durch das Zeigen der Denkketten die Modellstärke zu demonstrieren.

Liu Xiao, der Leiter von Zhipu AutoGLM, hat auch direkt gesagt, dass obwohl "Contemplation" einfache Aufgaben wie die Zusammenstellung von Forschungsberichten ausführen kann, derzeitig nur eine Vorschauversion für die Öffentlichkeit zur Verfügung steht und es noch viele Mängel gibt.

Ein direkter Vergleich zeigt, dass Manus durch die Nutzung der Computer Use-Fähigkeit von Claude Operationen auf mehreren Geräten wie PC und App durchführen kann und Ergebnisse in konkreter Form wie Präsentationen und Webseiten liefern kann.

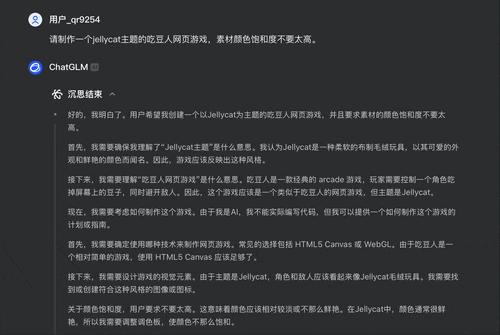

Beispielsweise kann Manus, wenn man den Prompt "Bitte erstelle ein Pac-Man-Webspiel mit einem Jellycat-Thema, die Farbsättigung der Materialien soll nicht zu hoch sein" eingibt, direkt eine ordentliche Spielwebseite liefern (obwohl die Ausführungszeit 45 Minuten beträgt und das Spiel Fehler hat).

Das von Manus gelieferte Pac-Man-Webspiel.

Aber die aktuelle Vorschauversion von "Contemplation" kann immer noch nur eine ähnliche Forschungsaufbereitung wie Deep Research (ein von OpenAI entwickeltes Forschungsintelligenz-Agent) liefern und ist nicht sofort einsatzbereit.

Wenn man den obigen Prompt eingibt, kann "Contemplation" nur den Code zur Realisierung des Spiels ausgeben. Der Benutzer muss ihn noch extra kopieren und ausführen, was für Benutzer ohne technischen Hintergrund nicht sehr freundlich ist.

Das von "Contemplation" gelieferte ist der Spielcode.

Ein Mitarbeiter von Zhipu hat der Zeitschrift "Intelligent Emergence" gesagt, dass "Contemplation" noch ein experimentelles Produkt ist. "Contemplation" kann noch keine Operationen auf mehreren Geräten durchführen. Um dies zu ermöglichen, müsste es Funktionen wie Computer Use wie GLM-PC (ein von Zhipu entwickeltes Computerbetriebsmodell) integrieren."

Nachdem Zhipu in den Bereich der Agenten investiert hat, welche technische Stärke will es eigentlich zeigen?

Bei der Open Day hat Zhang Peng die für die Realisierung von "Contemplation" erforderlichen Modellkombinationen erklärt: Das Basis-Modell GLM-4-Air-0414, das Inferenzmodell GLM-Z1-Air und das Contemplation-Modell GLM-Z1 - diese drei neuen Modelle entsprechen jeweils der für Agenten erforderlichen Sprachverständnis-, Problemanalyse- und Reflexionsüberprüfungsfähigkeit.

Die neuen Modelle hinter "Contemplation".

Es ist erwähnenswert, dass Zhipu das Konzept des "Contemplation Large Model" eingeführt hat, was auch die Exploration von Zhipu für die nächste Phase von R1 darstellt. Aus Sicht von Zhang Peng hat die herkömmliche KI beträchtliche Einschränkungen, wenn sie sich nur auf interne Wissensinferenz stützt.

Weiter als die eingeschränkte Inferenz geht "Contemplation" dahin, dass die KI in der Lage sein muss, in Echtzeit im Internet zu suchen, dynamisch Tools aufzurufen, tiefgreifend zu analysieren und sich selbst zu überprüfen, um die Zuverlässigkeit und Nützlichkeit der Ergebnisse zu gewährleisten.

Der "Preis-Schlächter" DeepSeek hat die Nachfolgeunternehmen gezwungen, entweder ihre Modelle zu open-sourcen oder Modelle mit höherem Kostennutzenverhältnis anzubieten.

Von den drei neuen Modellen, die Zhipu neu veröffentlicht hat, hat das Inferenzmodell GLM-Z1-Air eine achtmal schnellere Inferenzgeschwindigkeit als R1, aber nur ein 1/30 des Kostenbetrags und kann auf Consumer-Grafikkarten laufen. Gleichzeitig werden diese drei neuen Modelle am 14. April alle open-source sein.

Natürlich müssen die sechs jungen Talente in der "Post-DeepSeek"-Zeit die Fragen beantworten, ob sie die Vorhersage-Training fortsetzen sollen und wie sie die Kommerzialisierung gestalten sollen.

Im Folgenden sind einige Gedanken von Zhang Peng, dem CEO von Zhipu, auf der Pressekonferenz über Agenten und Modelltechnologie sowie die Kommerzialisierung, leicht bearbeitet von der Zeitschrift "Intelligent Emergence":

- Das Vorhersage-Training ist immer noch sehr wichtig. Obwohl das Vorhersage-Training derzeit nicht so viel Beachtung bekommt, hängen alle Methoden wie RL (Reinforcement Learning) im Wesentlichen von der Obergrenze des Basis-Modells ab, die durch das Vorhersage-Training erreicht wird. Als Hersteller von Basis-Modellen werden wir das Vorhersage-Training auf jeden Fall fortsetzen.

- Die zukünftigen neuen Applikationsformen, insbesondere die Applikationsformen von Intelligenz-Agenten, werden wieder auf das Modell zurückgreifen. Viele zukünftige Applikationen werden um das Modell herum aufgebaut sein, und wenn man ihnen eine dünne oder sehr einfache Produktumhüllung gibt, wird daraus ein Produkt. Sobald die Modellfähigkeit verbessert wird, wird auch die Produktfähigkeit verbessert. Dies ist ein typischer Wandel der neuen Applikationsparadigmen.

- Alle zwischengeschalteten Produktions- und Engineering-Methoden sind vorübergehende Maßnahmen und kompromisslose Lösungen. Wenn man einen so intelligenten Geist wie den eines Menschen erschaffen hat, gibt es weniger Engineering-Arbeiten. Man muss ihm nur Hände und Augen geben, und er kann wie ein Mensch viele Aufgaben erledigen. Dies ist das ultimative Ziel der AGI.

- Es hat sich gezeigt, dass nicht nur die Inferenz von Large Models dem Skalierungsgesetz folgt, sondern auch die Agenten ein ähnliches Skalierungsgesetz aufweisen. Durch die Erweiterung der Inferenz-Computing-Kapazität während des Trainings haben wir beobachtet, dass die Agenten eine stärkere Leistung zeigen.

- Für Unternehmen oder Benutzer, egal ob sie die API aufrufen oder Modelle kaufen, ist die Frage, wie man das Modell effektiv nutzt, das größte Problem. Unter dieser Voraussetzung ist die Frage, ob das Modell open-source oder kostenlos ist, nicht mehr so wichtig. Die Umsetzung erfordert die Zusammenarbeit beider Seiten.

- Die Erfahrungen der Vergangenheit, wie beispielsweise bei MySQL und Red Hat, haben bereits gezeigt, dass open-source nicht gleich komplett kostenlos ist. Es gibt auch die späteren Kosten für die technische Unterstützung und Wartung, sowie die Kosten für die Exploration, wie man DeepSeek lokal einsetzen kann. Dafür braucht man ein professionelles Team. Deshalb ist der Service das Geschäftsmodell von open-source.

- Universelle Agenten dürfen keine Schwächen haben. Warum ist die Denk- und Schreibfähigkeit einer KI weit über der eines Menschen, aber sie ist immer noch nicht so gut wie ein Mensch? Weil ihre Fähigkeiten ungleichmäßig verteilt sind. Die Existenz offensichtlicher Schwächen führt zu einem drastischen Abfall der Anwendungs-Erfolgsrate.

- Warum werden die aktuellen Agenten von Drittplattformen blockiert? Im Wesentlichen liegt es daran, dass sie nicht klug genug sind. Wenn sie den Turing-Test bestehen könnten, glaube ich, dass die aktuellen Blockierungs- und Sperrstrategien schwer durchführbar wären. Deshalb ist die Vermeidung von Blockierungen im Wesentlichen ein Engineering-Problem.

- Wir werden entsprechende Pläne im Bereich der Embodied Intelligence entwickeln, aber es wird wahrscheinlich noch etwas Zeit dauern.

- Ich denke nicht, dass wir ein To-B-Unternehmen sind. Ich hasse es, Labels zu bekommen. Wir tun nur das, was wir für sinnvoll halten. Diese Dinge werden in verschiedenen Szenarien oder bei verschiedenen Kunden unterschiedliche Anwendungsformen und Werte haben.