Wu Di from InMooTech: 3D Generation is the Last Piece of the Puzzle of "Spatial Intelligence" | An Exclusive Interview with 36Kr

Autor | Geng Chenfei

Redakteur | Song Wanxin

Titelbildquelle | Unternehmensfoto

Kürzlich hat das 3D-Modellunternehmen Yingmou Technology eine Series-A-Finanzierung in Höhe von mehreren Millionen Dollar abgeschlossen. Diese Finanzierungsrunde wurde von Meituan Longzhu und ByteDance angeführt, wobei die Altinvestoren Sequoia China Seed Fund und Krystal Ventures weiterhin investierten. Light Source Capital fungierte als exklusiver Finanzberater.

Laut Wu Di, dem Gründer von Yingmou Technology, wird die aktuelle Finanzierungsrunde hauptsächlich für die Erforschung von 3D-Großmodellen und zur Beschleunigung der Kommerzialisierung der Hyper3D-Produktserie, bei der das 3D-Modell Rodin im Mittelpunkt steht, auf dem globalen Markt verwendet.

Im Jahr 2024 hat sich das Interesse von Investoren und Märkten an KI schnell von technologischen Fortschritten auf kommerzielle Erträge verlagert. Berichten zufolge hat das von Yingmou Technology eingeführte Großmodell Rodin in nur 45 Tagen nach dem Start einen jährlichen wiederkehrenden Umsatz (ARR) von über 1 Million US-Dollar erzielt und ist damit ein seltenes kommerzielles Erfolgserlebnis im Bereich der KI-Start-ups.

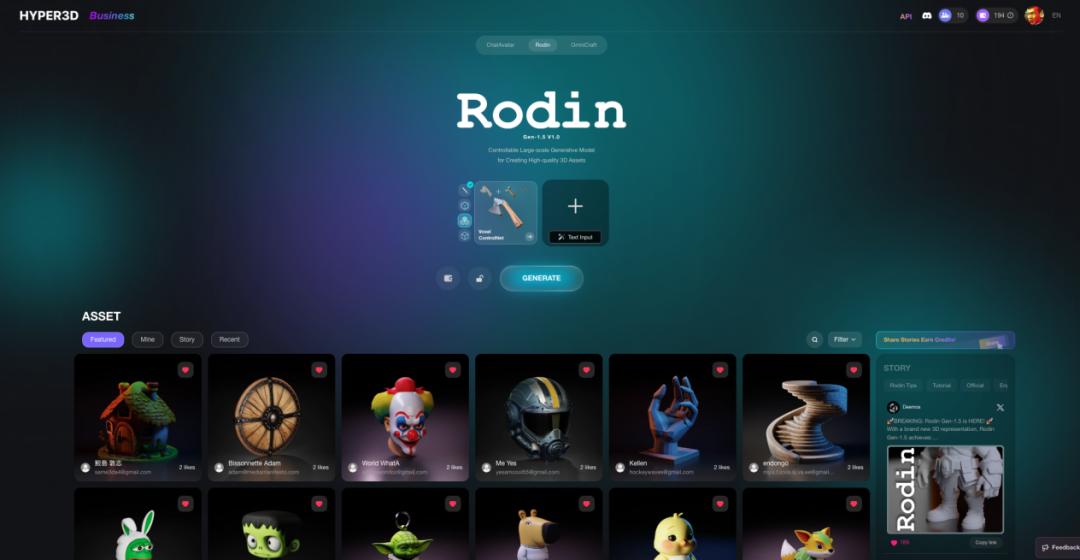

Bild: Rodin-Oberfläche; Bildquelle: Unternehmensfoto

Das schnelle Wachstum von Rodin spiegelt das immense Potenzial des Marktes für 3D-Generierung wider, insbesondere mit der rasanten Entwicklung neuer Anwendungsszenarien wie Metaverse, virtueller Realität und verkörperter Intelligenz steigt die Nachfrage nach 3D-Inhalten enorm an.

Branchenübergreifende Daten zeigen, dass der Gesamtwert des 3D-Modellierungs-Outsourcing-Marktes für Spiele und Unterhaltung, Film und Animation, Architektur und Immobilien (AEC), Fertigung und Produktdesign, E-Commerce und virtuelle Präsentationen zwischen 149 und 335 Milliarden US-Dollar liegt.

Allerdings ist die manuelle Erstellung von 3D-Modellen auf Basis der traditionellen Geometriemodellierung nicht nur zeitaufwändig, sondern erfordert auch ein hohes Maß an technischem Know-how, was die Effizienz und den Umfang der 3D-Inhaltsproduktion erheblich einschränkt. Vor diesem Hintergrund werden generative KI-Tools als Schlüssel zur Verbesserung der Effizienz der 3D-Generierung und zur Senkung der Zugangsschwelle bei der Erstellung von 3D-Inhalten gesehen.

Ein Problem besteht darin, dass, obwohl die AIGC-Welle weltweit grassiert, die meisten gängigen AIGC-Tools, die wir kennen, sich immer noch auf die Erzeugung von 2D-Inhalten wie Bildern und Videos konzentrieren. Der „ChatGPT“-Moment der 3D-Generierung steht noch aus.

Der Grund dafür ist, dass die Qualitätsbarriere bei der Generierung von 3D-Großmodellen aufgrund technischer Einschränkungen noch nicht wirklich durchbrochen wurde.

Im Vergleich zu Bildern und Videos müssen professionelle 3D-Inhalte weitaus komplexeren und strengeren Standards entsprechen. Neben der Generierungsgeschwindigkeit und -qualität müssen auch die Struktur und Topologie des 3D-Netzes, die UV-Mapping-Struktur und die Texturauflösung berücksichtigt werden.

Wu Di gibt zu, dass die Qualität der 3D-Generierung zwar auf ein neues Niveau gehoben wurde, die aktuelle 3D-Generierung in Bezug auf Materialverwendbarkeit, Topologie und UV-Entpackung jedoch noch nicht den Anforderungen der praktischen Anwendung entspricht. Diese technischen Schwachstellen stehen im Vordergrund der Herausforderungen, die in der 3D-Generierung zu überwinden sind.

Vor diesem Hintergrund beschleunigt sich das Tempo der Iteration von 3D-Generierungstechnologien weltweit. Letztes Jahr hat das Team von Yingmou in Zusammenarbeit mit der Shanghai University of Science and Technology die „steuerbare 3D-native DiT-Generierungsplattform CLAY“ und das „3D-Kleidungs-Generierungsframework DressCode“ entwickelt, die die Qualität der 3D-Generierung erheblich verbessert haben und als Grundlage der nächsten Generation der 3D-Generierung gelten.

In der Zwischenzeit sind weltweit mehrere KI-basierte 3D-Generierungsprodukte auf den Markt gekommen.

Im Ausland hat Meta das auf Text basierende 3D-Modell Meta 3D Gen eingeführt, das innerhalb einer Sekunde 3D-Material generieren kann. Google hat das Basisweltmodell Genie2 veröffentlicht, das auf Basis eines Bildes eine 3D-Umgebung erzeugt, die von menschenähnlichen oder KI-basierten Agenten gesteuert werden kann. NVIDIA hat Edify 3D vorgestellt, das die direkte Generierung von 4K-3D-Objekten und -Szenen aus Textvorgaben oder Bildern ermöglicht.

In China hat neben Yingmou Technology, das sein 3D-Modellierungsprodukt Rodin auf den Markt gebracht hat, auch Tencent das 3D-Modell Hunyuan3D-1.0 veröffentlicht, das die Umwandlung von Texten und Bildern in 3D-Vermögenswerte unterstützt und diesen Prozess in nur 10 Sekunden abschließen kann.

Man kann sagen, dass sich weltweit alle Teilnehmer im Bereich der 3D-Großmodelle im Wettbewerb befinden, um in der Technologieentwicklung eine kritische Masse für den qualitativen Durchbruch zu erreichen.

Allerdings ist aus Marktperspektive die derzeitige Benutzergrundlage der 3D-Generierung hauptsächlich auf Bereiche wie Spiele, Videoproduktion, E-Commerce und Industriewesendesign im B2B-Sektor beschränkt, während die Durchdringung im B2C-Sektor relativ gering ist.

Wu Di stellte in einem Gespräch mit 36Kr fest, dass 3D-Vermögenswerte aufgrund des aktuellen zweidimensionalen Geräteumfelds im Gegensatz zu Videos, Bildern und Musik nicht einfach über soziale Medien geteilt und verbreitet werden können.

Insbesondere im gegenwärtigen Umfeld, das von zweidimensionalen Geräten dominiert wird, ist die Nachfrage normaler Benutzer nach 3D-Vermögenswerten noch nicht ausgereift, und die Anwendungsszenarien sind ebenfalls begrenzt. Diese Realität hat deutlich Einfluss auf die Verbreitung und Förderung der 3D-Generierungstechnologie im Endverbrauchermarkt.

„Mit der kontinuierlichen Entwicklung und Popularisierung von Konsumgütern wie 3D-Druckern, AR und VR wird die 3D-Generierung jedoch voraussichtlich ein explosionsartiges Wachstum im Endverbrauchermarkt erleben.“ Wu Di ist überzeugt, dass mit der Reifung der Technologie die 3D-Generierung in immer mehr Bereichen Anwendung finden wird und sogar Teil der täglichen kreativen Arbeit und des Teilens von Inhalten durch normale Benutzer, ähnlich wie Texte, Bilder und Videos, werden könnte.

Bild: Yingmou-Team präsentiert Rodin 3D-Generierung in SIGGRAPH Real-time Live!; Bildquelle: Unternehmensfoto

Basierend auf der kommerziellen Markteinsicht verfolgt Yingmou bereits in der Forschungsphase das Ziel der Markteinführung, beispielsweise durch den Fokus des Unternehmens auf den „Production-Ready“-Standard.

Dieser Standard besagt, dass die generierten 3D-Modelle direkt in die Produktionspipeline integriert werden können, um so das Interesse der Benutzer in echte Produktivitätstools zu verwandeln und tatsächlichen Geschäftswert zu schaffen.

„In einer ferneren Zukunft, wenn das Metaverse und Roboter Teil des Alltags werden, wird die 3D-Generierung sicherlich ihren Durchbruch erleben.“ so Wu Di.

Kürzlich führte 36Kr ein Gespräch mit Wu Di, dem Gründer von Yingmou Technology. Nachfolgend finden Sie eine bearbeitete Fassung des Interviews:

36Kr: Als ein von einer Universität gegründetes Unternehmen basiert ein Großteil von Yingmous kommerzieller Entwicklung auf akademischer Forschung. Können Sie uns darüber berichten?

Wu Di: Yingmou wurde an der Shanghai University of Science and Technology gegründet und forscht seit 2016 im Bereich 3D-Modellierung. Im Jahr 2024 wurden zwei unserer Artikel über 3D-Großmodelle für den SIGGRAPH Best Paper Award nominiert, und wir wurden zweimal in den SIGGRAPH Real-Time Live! ausgewählt, was das erste Mal seit 50 Jahren für ein Festlandchinesisches Team sind.

36Kr: Warum konnte Rodin in nur 45 Tagen nach der Markteinführung einen ARR von 100.000 US-Dollar erreichen?

Wu Di: Das ist hauptsächlich unserem präzisen Marktfokus und unserer Produktstärke zu verdanken. Während der Forschung und Produktentwicklung haben wir ständig „Production-Ready“ als Kerzielle Anforderung betrachtet. Wir haben die Technologie entwickelt, die direkt einsatzbereit ist. In unserem Forschungsprozess haben wir alle Technologierouten verglichen und uns gegen die damals weit verbreitete „2D-to-3D“-Technik entschieden und stattdessen die weniger populäre „3D-native route“ gewählt, bei der das Modell trainiert, überwacht und generiert wird.

36Kr: Was war die Überlegung hinter Yingmous Entscheidung, sich in der Technologieentwicklung nicht dem 2D-zu-3D-Pfad anzuschließen und stattdessen den 3D-native Pfad zu wählen?

Wu Di: Der 2D-zu-3D-Pfad war damals allgemein anerkannt und weit verbreitet, da die Gewinnung von 3D-Informationen aus der Perspektive mehrerer 2D-Bilder intuitiver schien. Viele haben angemerkt, dass 3D-Ressourcen nicht ausreichen und durch 2D-Ressourcen ergänzt werden müssen. Bei unseren ersten Gesprächen mit Zielkunden stellten wir jedoch fest, dass sie nicht nur in der Lage sein wollten, 3D-Modelle zu erstellen, sondern auch, dass die Verwendbarkeit dieser Modelle eine entscheidende Rolle spielte.

Wir kombinierten unsere mehrjährige Forschungserfahrung im Bereich der Computergrafik und erkannten, dass Informationen beim Komprimieren von 3D-Daten in 2D, unabhängig von der Anzahl der Blickwinkel, nicht vollständig ausgedrückt werden können, was es schwierig macht, dass 2D-zu-3D den Standards der Kunden gerecht werden kann. Die 3D-native Route kann mehr Informationen beibehalten, was eine höhere Obergrenze für die Generierungsqualität ermöglicht.

Hätten wir damals die 2D-zu-3D-Route gewählt, hätten wir vielleicht schneller ein Produkt auf den Markt bringen können, aber letztendlich taten wir das nicht und Rodin Gen-1 wurde etwa ein halbes Jahr nach den Mitbewerbern veröffentlicht.

36Kr: Viele Unternehmen sorgen sich oft darüber, dass ihr Produkt später als das der Konkurrenz auf den Markt kommt. Hatten Sie keine Bedenken bei dieser Entscheidung?

Wu Di: Es war in der Tat eine „Wer später kommt, wird belohnt“ Entscheidung, aber wir zögerten nicht, weil wir fest davon überzeugt waren, dass nur die 3D-native Technologieroute den kommerziellen Standards näherkommen könnte. Intern nannten wir es „Production-Ready“, was auch der Kernstandard für die Forschung und Produktentwicklung bei Yingmou ist. Um „Production-Ready“ zu erreichen, reicht es nicht, nur Modelle zu erstellen; wir müssen auch in der 3D-Darstellung, Topologie, UV-Entpackung und Materialkompatibilität mehr leisten. Rodin Gen-1 wurde zwar später als andere Produkte veröffentlicht, aber es war das erste 3D-Großmodell, das diese Verwendbarkeitshürde überschritt. Auch wenn unser aktuelles Modell die Grenze für die Generierungsqualität erhöht hat, gibt es dennoch einen Weg, um in den Produktionsprozess integriert zu werden.

36Kr: Wo genau bestehen in der Praxis noch Unterschiede?

Wu Di: In bestimmten Szenarien, wie beim Einsatz in Spielen, gibt es sehr strenge Anforderungen an die Modelle, z. B. in der Topologiestruktur, beim UV-Entpacken und in einigen absoluten Detailanforderungen. Obwohl wir sehr gut abschneiden, besteht noch ein Unterschied. Benutzer müssen die Modelle oft anpassen oder sogar neu erstellen.

36Kr: Wie sieht die Umsatzverteilung des Unternehmens aus?

Wu Di: 70% unserer Einnahmen stammen aus dem Ausland, mit Geschäftsverbindungen in den USA, Europa, Japan und Südkorea, wobei Europa und die USA etwa 50% der Einnahmen ausmachen. Beispielsweise hat ein deutscher Kunde unsere API genutzt, um ein sehr attraktives Produkt zu entwickeln, das allein über 50.000 US-Dollar ARR generiert hat.

36Kr: Wer sind die Kernkategorien der Kunden von Yingmou?

Wu Di: Derzeit liegt der Schwerpunkt auf Spielen, Videoproduktion und E-Commerce in den Szenarien der Unterhaltung und des neuen Konsums. Doch die 3D-Generierung erweitert ständig ihre Anwendungsgrenzen; beispielsweise sind 3D-Druck, verkörperte Intelligenz und Industriedesign unsere zukünftigen Kernziele.

36Kr: Gibt es konkrete Beispiele dafür?

Wu Di: Ein Beispiel ist unsere Zusammenarbeit mit Tuozhu, wo Tuozhu auf Grundlage unserer Technologie ein Produkt entwickelt hat, das sie dann den Kunden zur Verfügung stellen. Beim offiziellen Printmo-Projekt von Tuozhu kann der Benutzer einfach ein Bild hochladen, das KI in einen Pokémon-Stil umwandelt, und dann wird es durch unsere Technologie zu einem 3D-Modell umgewandelt, welches vom 3D-Drucker des Benutzers ausgedruckt wird. Es ist unser erster Versuch im Bereich 3D-Druck.

36Kr: Welche Auswirkungen haben die Anforderungen dieser Kunden auf die technologischen Iterationen von Yingmou?

Wu Di: Alle technologischen Iterationen von Yingmou basieren fast vollständig auf Kundenwünschen. Beispielsweise benötigen die in Bereichen wie Spiel- und Videoproduktion benötigten Modelle spezifische Eigenschaften wie raffinierte Topologie und hochdotierte UVs. Unsere zukünftige Forschung und Entwicklung wird in diese Richtung zielen. Wenn wir jedoch in den Bereich Industriedesign wechseln, sind die Anforderungen völlig anders. Aus langfristiger Perspektive streben wir eine universelle 3D-Darstellung an, die in verschiedenen Szenarien anwendbar ist und in der Lage ist, dreidimensionale Modelle für verschiedene Bedürfnisse gut zu verwandeln und zu adaptieren.

Ende 2024 haben wir die neueste Version von Rodin Gen-1.5 veröffentlicht. Dieses Update hat die lang bestehenden Probleme von dünnen Flächen und Kanten in der Branche mit unserem neuen 3D-nativen Ausdruck vollständig gelöst und ermöglicht es, Modelle mit schärferen und geraderen Kanten zu erzeugen. Dies war besonders wichtig in den Bereichen Spiel- und Produktdesign. Dieses Update hat unsere Produktführungsposition erneut deutlich ausgebaut.

36Kr: Wie sieht Yingmou die Zukunft der 3D-Generierung?

Wu Di: Die 3D-Generierung hat in Zukunft noch großes Potenzial zur Weiterentwicklung. Um persönliche Kreativität in AR/VR-Umgebungen zu realisieren, müssen die Nutzer in der Erstellung von 3D-Inhalten entlastet werden. Als ein im dreidimensionalen Raum konstruiertes System wird das Verständnis der Maschinen für die Welt in Zukunft auch auf drei Dimensionen basieren. Die 3D-Generierung wird einen wesentlichen Bestandteil der räumlichen Intelligenz darstellen.

Besuchen Sie uns, um weitere Informationen zu erhalten